Qui a peur de la publicité ciblée ?

Dans l’immense entreprise de profilage qui sous-tend le numérique, la « pub ciblée » est un arbre bien placé pour cacher la forêt.

Où est le mal, si entre deux vidéos visionnées en ligne, on me propose de remplacer mon aspirateur qui vient de tomber en panne ? Intrusif, un peu. Inquiétant, pas vraiment.

C’est tout le talent des « data hoarders » (littéralement « amasseurs de données »). Avoir réussi à circonscrire les enjeux très profonds d’une surveillance intime de tous les instants à une question bénigne : « est-ce que c’est important qu’on me propose des publicités adaptées à mes goûts ? » « après tout je n’ai rien à cacher ».

Comment ne pas penser à ces mots de Verbal Kint (Kevin Spacey) dans le classique Usual Suspects (1995) :

Le plus grand tour que le diable ait jamais joué à l’humanité, c’est de lui avoir fait croire qu'il n'existait pas

Un peu mélodramatique. Les entreprises numériques qui collectent vos données pour elles et pour les autres ne sont pas des incarnations digitales sataniques… Elles manient cependant parfaitement les mêmes armes : la ruse et la diversion.

Focaliser le débat sur la publicité occulte une bonne partie de l’usage qui est ou sera fait de vos données

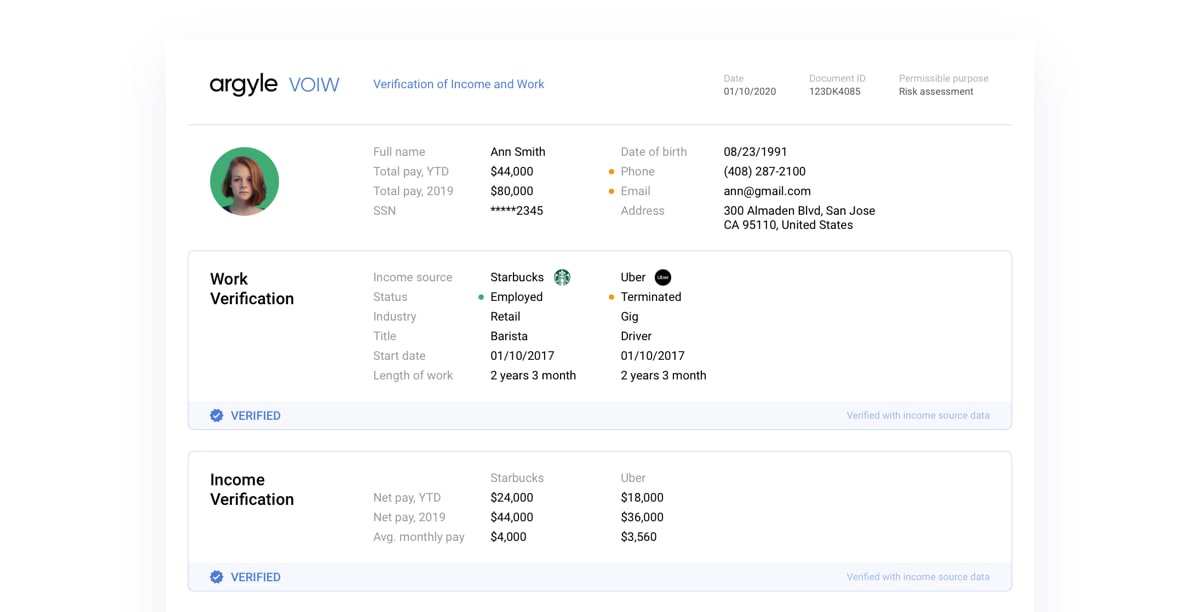

Aux États-Unis, la start-up Argyle se fait fort de collecter et de reconstituer l’« historique professionnel » de chacun : postes, réputation, qualité du travail fourni, salaire sont ainsi agrégés et revendus aux recruteurs, banques et assureurs. Ils revendiquent avoir déjà établi 40 millions de dossiers personnels. De quoi, promettent-ils, « comprendre de façon inédite les comportements professionnels et financiers d’une personne »...

L’entreprise a récemment été interpelée sur le recueil du consentement des personnes concernées. La réponse se fait toujours attendre.

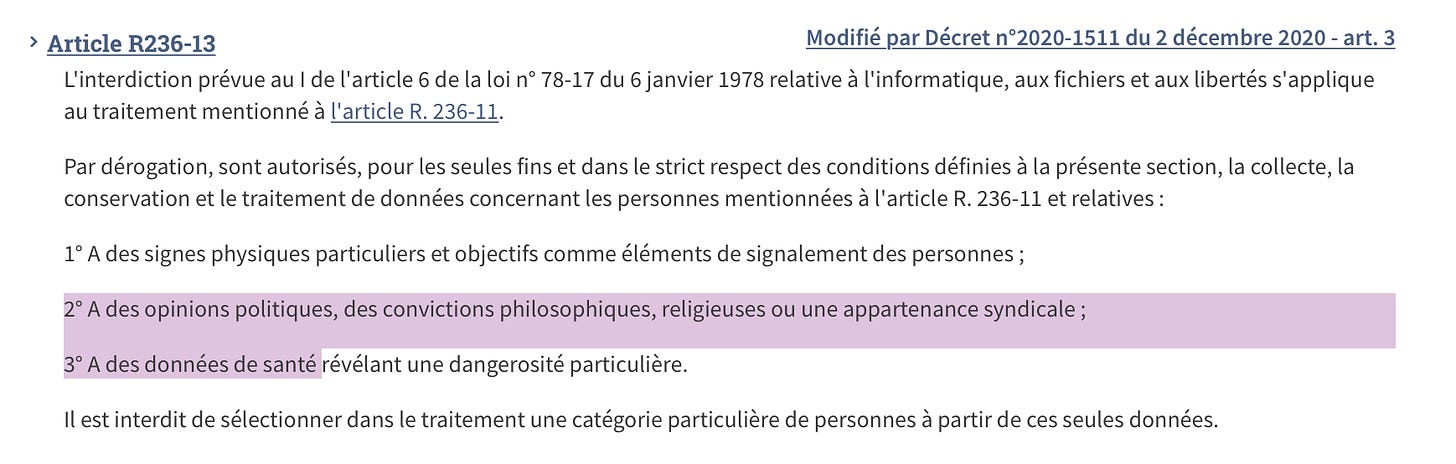

Plus près de nous en France des fichiers vont collecter les « opinions politiques » affichées sur les réseaux sociaux. Publiées en toute discrétion le 4 décembre au journal officiel, ces modifications concernent le fichier prévention des atteintes à la sécurité publique (PASP) employé par la police, le fichier gestion de l'information et prévention des atteintes à la sécurité publique (GIPASP) utilisé par la gendarmerie, et le fichier des enquêtes administratives liées à la sécurité publique (EASP).

Les informations pourront être « collectées sur des pages ou des comptes ouverts » indique la CNIL et elles concerneront « principalement les commentaires postés sur les réseaux sociaux et les photos ou illustrations mises en ligne ».

Détail important : là où les « activités » politiques, philosophiques, religieuses étaient jusque là visées, ce sont désormais les « opinions » et « convictions » exprimées qui le sont. Le glissement sémantique est loin d’être anodin, même si le Ministère de l’Intérieur préfère pudiquement parler d’une « évolution terminologique ».

Viser ce que vous pourriez faire plutôt que ce que vous faites : les anticipations de l’écrivain Philip K. Dick s’incarnent donc brutalement. Un peu trop : aux États-Unis, les logiciels de « police prédictive » commencent à être abandonnés. Après San Francisco en mai 2019, Oakland en juillet, c’est Santa Cruz qui vient de les interdire. Effets non prouvés, accentuation des discriminations, renforcement des biais...

Pas de quoi effrayer en France. L’entreprise Map Revelations et son éditeur SureteGlobale.org travaillent avec des mairies mais aussi la Police nationale, la Police aux frontières, la gendarmerie. Leur ambition, dans les mots du fondateur basé à Angers ? « Prédire les faits spatio-temporels dans le domaine de la délinquance ». Et parmi ses activités secondaires, on retrouve bien évidemment du « géomarketing » pour aider les entreprises « mieux cibler » leurs produits et leurs clients.

La boucle est bouclée. Revoilà la publicité ciblée, pour une fois ramenée à sa vraie place dans les enjeux de la surveillance constante dont nous faisons l’objet : celle d’un bénéfice secondaire.

Que nous le voulions ou non, notre présence en ligne dresse un portrait intime de nous-même

Ne nous y trompons pas : le produit, c’est bel et bien nous. Dans les exemples précédents, l’enjeu est tour à tour de savoir si nous en tant qu’individus sommes de bon ou mauvais clients, bon ou mauvais employés, bon ou mauvais citoyens. La seule façon de le découvrir : collecter, actualiser, croiser de la données en permanence, vendue par un organisme à un autre.

Et dans le marché de la surveillance, on nous « vendra » d'autant mieux que les données dont on dispose sur nous sont précises. Mais comment regarder une vidéo en ligne ou laisser un like peut-il mener à une connaissance aussi intime ?

Après 10 « j’aime » de votre part, Facebook connaît déjà mieux votre personnalité qu’un collègue de travail. 70, et c’est votre colocataire qui est distancé. À 150, l’entreprise de Mark Zuckerberg vous a mieux cerné(e) que vos parents. Et après 300 « j’aime », Facebook est capable de prédire vos réactions mieux que votre conjoint(e).

Ce sont les résultats d’une étude menée conjointement par des chercheurs des universités de Cambridge et de Stanford sur près de 17 000 comptes. Leur algorithme a fini, avec suffisamment de données, par être plus précis que n’importe quel participant humain dans la définition des traits de caractère d’une personne.

La clé est donc la fréquence et la diversité des interactions. Plus nous consommons / cliquons, mieux nous sommes connus. Cet enjeu est parfaitement visible dans l’évolution des applications dites « de contenus » (informations, photos, vidéo...) ; les dernières nées sont aussi celles qui génèrent le plus de « contenus consommés » par session :

YouTube : 3 à 5

Twitter : 50-75

Instagram : >100

Tiktok : >200

Là où Netflix reçoit un seul signal de votre part lorsque vous regardez un film d’une heure et demie, Tiktok en récupère 50 à 150 grâce à ses vidéos d’une minute.

Chacun accumule donc des données dans son coin. Mais que se passent-ils quand ces données sur vous sont mises en commun (car elles le sont) ? Dès 2014, Steven Englehardt (alors à l’université de Princeton) avait publié une étude montrant comment les trackers des sites internets se « synchronisent » d’un site à l’autre pour assurer la continuité du suivi de vos visites en ligne.

Fréquence, étendue, partage : le profiling à haute vélocité ne fait donc que s’intensifier. À tel point qu’en décembre dernier, Microsoft a déposé un brevet pour un robot conversationnel (chatbot) capable, une fois absorbés tous les messages, contenus publiés sur les réseaux sociaux, photos ou écrits d’une personne, de converser via messages interposés exactement comme elle. De quoi par exemple faire « revivre » des stars décédées ou un proche disparu le temps d’un échange de SMS...

Une course à la prédictabilité

Cette accumulation compulsive de données relève presque de la pathologie. La syllogomanie désigne la folie de l’amoncellement, qu’on retrouve chez certaines personnes et qui relève de la psychiatrie : accumuler de manière excessive des objets, indépendamment de leur utilité ou de leur valeur immédiate.

Après une journée de conduite, un possesseur de Tesla s’émerveillait ainsi des plus de 4 gigaoctets de données envoyés à la « maison mère ».

Que permettent vraiment ces quantités astronomiques de données ? Shoshana Zuboff, professeure émérite de la Harvard Business School, a popularisé le concept de « Capitalisme de surveillance » dans un livre du même nom. La formidable richesse des Google et autres Facebook réside selon elle dans la capture, l’exploitation et l’analyse à un niveau industriel de nos informations pour en tirer de la prédictabilité.

C’est là que se situe la véritable mine d’or, sur laquelle se battent les géants du numérique. Vendre des prédictions aussi exactes que possibles, à grand renforts d’algorithmes, à tous les clients intéressés. En ce sens, elle ajuste l’adage selon lequel « nous sommes le produit » : le véritable produit sont les prédictions à notre sujet, et nous sommes la matière première qui permet de les affiner. Il faut donc extraire autant de données que possible en continu pour améliorer les modèles comportementaux. C’est ce que Shoshana Zuboff appelle « l’impératif d’extraction » : toujours plus, toujours plus souvent. Et aussi souvent que possible, avec notre concours, comme lors de la transformation du bouton « j’aime » de Facebook en une gamme d’emojis nous invitant à expliciter de nous-mêmes nos émotions.

La connaissance mène invariablement au contrôle

Or il existe aussi selon Shoshana Zuboff une autre façon de rendre les prédictions à notre sujet encore plus exactes. On peut déduire notre prochaine action / intention... ou les provoquer.

« L’accumulation d'une masse critique de connaissance sur un système entraîne nécessairement une forme de contrôle de ce système. » À travers les multiples points de contact quotidien, ces entreprises sont capables de nous faire ressentir certaines émotions, et d’induire certains comportements.

Pokemon Go et sa mignonne chasse aux Pokemons géolocalisés lancée en 2016 a bien vite commencé à diriger physiquement les joueurs, téléphones mobiles en main, vers des « lieux sponsorisés ». En 2014, les détails d’une étude menée par Facebook ont été publiés. Ils montraient comment susciter des émotions positives ou négatives en manipulant les flux d’informations auxquels 689 000 utilisateurs étaient exposés.

Et quid de Tiktok, cité plus haut pour son « profiling haute fréquence » ? L’application a poussé le système encore plus loin en ne proposant jamais de recommandations (comme peuvent le faire Netflix ou Youtube). L’utilisateur n’a jamais de « choix » conscient à faire : c’est la plate-forme qui décide de ce qu’il ou elle va voir. De quoi optimiser son flux de contenus pour le plus grand bonheur (au sens littéral du terme) des spectateurs. L’ « ambiance » positive de l’application, largement appréciée des media (pas de prises de bec, de guéguerres d’influenceurs ou de nouvelles déprimantes), est entièrement sous le contrôle de Tiktok.

Mais s’il est possible de nous donner le sourire, il est tout aussi aisé de jouer sur d’autres émotions. À Marseille, le projet de collecte massive de données sur la voie publique à des fins de surveillance porte le joli nom de « Big data de la tranquillité publique » comme le soulignait à son lancement la Quadrature du Net. Ça ne s’invente pas. À Nice, on va maintenant détecter si vous êtes trop stressé dans le tramway grâce à la reconnaissance faciale.

Au menu donc : vous mettre de bonne humeur, vous tranquilliser, et pourquoi pas aussi vous indigner ou vous chauffer à blanc, comme lors des récents événements du Capitole aux États-Unis. Des entreprises, mais aussi des groupes d’intérêts privés ou même des États. Nous voilà bien loin de la publicité ciblée.